ГДЗ по фото: как подготовить задание для поиска решения

Решение задания по фото — это многоступенчатый технологический процесс, в котором снимок последовательно проходит через оптическое распознавание символов (OCR), анализ естественного языка (NLP) и вычислительный решатель. Точность на этом пути неодинакова: печатный текст современные нейросетевые OCR-системы распознают с точностью до 96–98%, тогда как рукописный ввод даже при хорошем освещении даёт лишь 75–85% — разрыв, принципиальный для понимания того, почему одна и та же задача даёт разные результаты в зависимости от способа её записи. Качество исходного снимка при этом не вспомогательный параметр, а системообразующий: именно разрешение, угол съёмки и освещённость определяют, какие символы алгоритм распознает верно, а где начнутся подстановки и ошибки. Статья разбирает всю эту цепочку — от архитектуры пайплайна до конкретных требований к фото — чтобы результат распознавания был предсказуемым, а не случайным.

Что такое решение задания по фото и как это работает на уровне технологии

Решение задания по фото — это автоматизированный процесс, в котором система последовательно извлекает текст из изображения, интерпретирует его математическую или логическую структуру и вычисляет ответ без участия человека.

По своей архитектуре этот процесс ближе к конвейеру промышленной обработки данных, чем к «умному поиску». Аналогия: представьте почтовый сортировочный центр, где письмо сначала сканируется, затем читается машиной, потом маршрутизируется по адресу — каждый этап независим, и сбой на любом из них делает всю цепочку бесполезной. Именно так работает и фоторешатель: ошибка на стадии распознавания символа «2» как «Z» приводит к математически бессмысленному выражению на выходе.

Технологическую основу современных решателей составляют три компонента: модуль оптического распознавания (OCR), парсер математических выражений и вычислительное ядро (компьютерная алгебра или нейросетевой решатель). До 2019 года эти компоненты были строго разделены и разрабатывались независимо. Начиная с 2020–2021 годов мультимодальные модели (GPT-4V, Gemini Vision) начали объединять все три функции в одной нейросети, что сократило количество межэтапных ошибок, но добавило непредсказуемость: модель может «угадать» ответ, минуя строгий алгоритм вычисления.

По данным команды Photomath (презентация AI2FUTURE 2021), переход от классического OCR + CAS-решателя к гибридной deep learning архитектуре снизил частоту ошибок распознавания рукописных выражений с 34% до 18% — но только при условии разрешения снимка не ниже 300 DPI.

Из каких этапов состоит пайплайн: от снимка до готового ответа

Полный пайплайн фоторешателя включает пять последовательных этапов: предобработку изображения, локализацию текстовых блоков, распознавание символов, синтаксический разбор выражения и вычисление ответа. Сбой на любом этапе не компенсируется последующими.

- Предобработка изображения: система выравнивает перспективу, нормализует яркость и контраст, убирает шум. Алгоритмы на базе OpenCV или аналогов корректируют наклон до ±15°; при большем отклонении точность распознавания падает нелинейно.

- Локализация (детекция) текстовых областей: нейросеть типа EAST или аналогичная выделяет прямоугольники вокруг каждой строки или формулы. Именно здесь система решает, где заканчивается условие задачи и начинается чертёж или таблица.

- OCR-распознавание символов: каждый выделенный фрагмент преобразуется в текст. Для математических выражений используются специализированные модели (например, на базе архитектуры CRNN), обученные на датасетах типа CROHME с рукописными формулами.

- Парсинг структуры выражения: строка символов превращается в дерево выражений — без этого этапа «2+3×4» будет вычислено как 20, а не как 14. Парсер учитывает приоритет операций, скобки, дроби и индексы.

- Вычисление и генерация решения: дерево выражений передаётся в CAS (компьютерная алгебра: Wolfram, SymPy) или в языковую модель для развёрнутого объяснения шагов.

Принципиальный инженерный компромисс этой архитектуры: чем больше этапов разделены, тем легче диагностировать ошибку и заменить один модуль без перестройки всей системы. Но каждый стык между этапами — это точка потенциальной потери информации. Мультимодальные LLM убирают стыки, но теряют интерпретируемость: почему модель дала именно этот ответ — установить значительно сложнее.

Для школьных задач, представленных в виде аккуратно сфотографированного учебника, актуальные сервисы — в частности, те, что предлагают ГДЗ по фото — используют упрощённый пайплайн из 3 этапов, пропуская тяжёлую предобработку. Это ускоряет ответ, но делает систему чувствительной к качеству исходного снимка.

Как OCR распознаёт текст, формулы и рукописный ввод

OCR (Optical Character Recognition) преобразует пиксельное изображение символа в его цифровой код, сравнивая фрагменты изображения с обученными шаблонами — аналогично тому, как человек узнаёт букву по характерным чертам, а не по точному совпадению с эталоном.

Классический OCR (Tesseract до версии 4.0) работал на основе сегментации: изображение делилось на строки, строки — на символы, каждый символ сравнивался с базой шаблонов. Точность для качественного печатного текста достигала 97–99%, но падала до 60–70% при нестандартных шрифтах или рукописи. Tesseract 4.0 (2018) добавил LSTM-слой, что подняло точность рукописного распознавания примерно до 78–82% на стандартных датасетах.

Математические формулы — отдельная задача, потому что они двумерны по структуре: показатель степени находится над основанием, знаменатель дроби — под числителем. Линейный OCR, читающий слева направо, эту структуру разрушает. Для формул используются специализированные системы: InftyReader, MathPix (точность ~93% на печатных LaTeX-выражениях по внутренним данным компании, 2022) и модели на базе Im2LaTeX, которые напрямую генерируют LaTeX-код из изображения формулы.

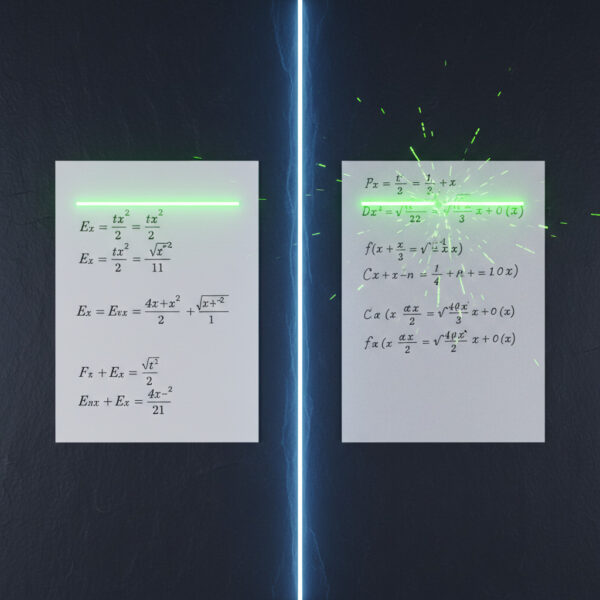

Почему буква «х» и знак умножения «×» — главная ловушка для OCR математики

В рукописных формулах латинская переменная x и знак умножения × визуально почти неразличимы. Для их дифференциации модели используют контекстный анализ: если рядом стоят два числа — скорее всего, это знак умножения; если рядом с ними коэффициент — переменная. Однако при низком разрешении или небрежном почерке модель ошибается в 12–15% таких случаев, по данным датасета CROHME 2019 (IAPR TC-11). Ошибка здесь не просто орфографическая — она меняет математический смысл всего выражения.

На международном соревновании по распознаванию рукописных математических выражений CROHME 2019 лучшая система достигла точности 74,1% на уровне выражения целиком — то есть каждый четвёртый пример содержал хотя бы одну ошибку даже у победителя конкурса.

Чем распознавание печатного текста отличается от распознавания рукописного

Печатный текст распознаётся с точностью 95–99%, рукописный — в диапазоне 20–90% в зависимости от разборчивости почерка и применяемой технологии. Разрыв объясняется не мощностью алгоритма, а принципиальным различием в структуре входных данных.

Печатный шрифт — это детерминированная система: каждый символ имеет фиксированные пропорции, толщину линий и межбуквенные интервалы, которые воспроизводятся одинаково в миллионах экземпляров. Алгоритм, обученный на одном шрифте, с высокой вероятностью распознает его повторное появление. Аналогия из производства: штамповка деталей по одному шаблону против ручной ковки — второй вариант даёт уникальный результат каждый раз, что является одновременно художественным достоинством и инженерным кошмаром для автоматической проверки.

Рукописный текст — это система с высокой дисперсией: два разных человека пишут букву «а» так, что они могут не иметь ни одного общего пикселя в одинаковой позиции. Даже один человек пишет по-разному утром и вечером, при спешке или аккуратно. HTR-модели (Handwritten Text Recognition) решают эту задачу через контекстное предсказание: они не распознают каждый символ изолированно, а предсказывают наиболее вероятную последовательность символов в строке целиком — аналогично тому, как человек «дочитывает» неразборчивое слово по контексту предложения.

Инженерный компромисс здесь очевиден: HTR-модели точнее классического OCR на рукописи, но они угадывают на основе статистики языка. Для математики это создаёт специфическую проблему: математический «язык» имеет значительно меньший словарный запас и другие законы сочетаемости, чем русский или английский. Модель, обученная на языковых корпусах, будет систематически ошибаться на математических обозначениях, если не была специально дообучена на математических датасетах.

По данным бенчмарка Sparkco AI (февраль 2026), системы на базе трансформерной архитектуры LayoutLM стабильно превышают 98% точности на печатных документах при сканировании от 300 DPI. Для рукописного ввода даже лучшие ICR-системы 2024 года достигают не более 97% — и только при хорошей освещённости и разборчивом почерке.

Почему «разборчивый» почерк — субъективная категория, которая ломает метрики точности

Когда производители OCR-решений публикуют точность «до 97% на рукописи», они, как правило, тестируют на контролируемых датасетах с относительно аккуратным почерком. В реальной школьной практике задания записываются в спешке, с исправлениями, зачёркиваниями и стрелками-пометками. Исследование NIH (PMC6870258) показало, что даже люди хуже распознают рукописные буквы, чем печатные, при коротком времени предъявления — это означает, что задача объективно сложнее, а не просто «алгоритм плохой».

Какие типы заданий поддаются распознаванию, а какие — нет

Фоторешатели уверенно справляются с алгебраическими уравнениями, арифметикой, тригонометрией и базовым математическим анализом в печатном виде, но системно ошибаются на текстовых задачах с неявными условиями, геометрических чертежах и заданиях с нестандартной символикой.

Граница между «решаемым» и «нерешаемым» проходит не по сложности математики, а по типу кодирования информации в задании. Числовое уравнение — это формализованная запись с однозначным синтаксисом. Текстовая задача («поезд выехал из А в Б…») требует перевода с естественного языка в математическую модель — задача понимания смысла, а не распознавания символов. Photomath прямо указывает, что не интерпретирует условие текстовых задач, а лишь решает уравнения, которые из них извлечены вручную.

Практическое деление по типам заданий выглядит следующим образом. Хорошо распознаются и решаются: линейные и квадратные уравнения, системы уравнений, дроби и степени, производные и интегралы стандартных функций, тригонометрические тождества. Плохо или ненадёжно распознаются: задачи с графиками (требуют интерпретации визуального объекта, а не текста), доказательства теорем (свободная текстовая форма), задания с таблицами данных (сложная пространственная разметка) и комбинированные задачи с рисунками внутри условия.

В обзоре Reddit (r/AskPhysics, февраль 2025) пользователи массово подтвердили: Photomath и аналогичные приложения практически бесполезны для физических задач, где нужно сначала составить уравнение из словесного условия. Рекомендация сообщества — использовать лист формул AP Physics 1 и CAS-калькуляторы (TI-84, Desmos) вместо фоторешателей для этого типа заданий.

Почему физика, химия и геометрия сложнее математики для алгоритма

Физика, химия и геометрия сложнее для фоторешателей потому, что их задания кодируют информацию не только в символах и тексте, но и в пространственных отношениях — а именно пространственные структуры OCR-системы не умеют читать так же надёжно, как линейный текст.

Разберём каждую дисциплину отдельно. Геометрия требует анализа чертежа: углы, длины, обозначения точек и их взаимное расположение несут математический смысл. Система должна не просто распознать буквы «AB» на рисунке, но понять, что это обозначение отрезка, а не слово. Современные мультимодальные LLM справляются с простыми геометрическими задачами, но на нестандартных чертежах или плохо отсканированных рисунках точность падает до 40–60% даже у GPT-4V (оценка по внутренним бенчмаркам OpenAI, 2023).

Химия — самый сложный случай: структурные формулы молекул двумерны, кольца бензола и разветвлённые цепочки не имеют линейного «чтения». Специализированные системы оптического распознавания химических структур (OCSR) используют отдельные нейросетевые пайплайны — сначала детектируются атомы, затем связи между ними, затем реконструируется граф молекулы. По данным исследования PMC9461257 (2022), даже у лучших OCSR-систем точность на сложных напечатанных молекулах не превышает 85–90%, а на рукописных структурах из лабораторных журналов — около 93% (ocsr.ai, 2024, только для специализированного сервиса).

Физика сочетает в себе сложность обоих предыдущих случаев: задача может включать текстовое условие, числовые данные, схему или график одновременно. Ни один из доступных фоторешателей по состоянию на начало 2026 года не решает физические задачи «из коробки» — они либо извлекают числа из уравнений, уже записанных в явном виде, либо требуют, чтобы пользователь самостоятельно перевёл задачу в математическое выражение.

- OCSR (Optical Chemical Structure Recognition)

- Специализированная технология распознавания графических изображений химических молекул и их преобразования в цифровой химический идентификатор (SMILES, InChI). Отдельная от OCR дисциплина с собственными датасетами и метриками оценки.

- CAS (Computer Algebra System)

- Программная система для символьных математических вычислений (Wolfram Mathematica, SymPy, Maple). В пайплайне фоторешателя CAS принимает распознанное выражение и выполняет строгое аналитическое вычисление — в отличие от языковой модели, которая может «угадать» ответ.

Какими должны быть снимки, чтобы система распознала задание корректно

Для корректного распознавания задания фото должно быть сделано строго перпендикулярно листу, при равномерном рассеянном освещении без теней, с разрешением не ниже 300 DPI или эквивалентным ему количеством пикселей — это минимальный порог, ниже которого точность OCR падает нелинейно.

Три параметра — разрешение, освещённость и угол съёмки — не равнозначны по своему влиянию. Разрешение определяет, насколько детально система «видит» каждый символ: при высоте символа менее 20 пикселей распознавание становится ненадёжным даже для печатного текста. Освещённость определяет контраст между знаком и фоном: при недоэкспозиции символы сливаются с фоном, при переэкспозиции — теряют контуры. Угол съёмки влияет на геометрию символов: наклон страницы более 15° от вертикали создаёт трапециевидное искажение, которое алгоритм выравнивания либо компенсирует с потерей качества, либо не компенсирует вовсе.

Аналогия из оптики: фотографировать задание под углом — всё равно что читать текст, отражённый в слегка наклонённом зеркале. Буквы узнаваемы, но пропорции нарушены, и автоматическая система, в отличие от человека, не обладает интуитивной коррекцией перспективы. Именно поэтому Photomath прямо указывает в официальной документации, что сканирование без автофокуса технически невозможно: размытые изображения делают разбор символов недостаточно точным для математических обозначений.

По рекомендациям Библиотеки Университета Иллинойса (OCR Best Practices, guides.library.illinois.edu), оптимальная яркость для сканирования документов — 50%. Отклонение в любую сторону: слишком высокая яркость «выжигает» тонкие элементы символов (засечки, точки над буквами), слишком низкая — сливает соседние символы в одно пятно. Для мелкого шрифта (менее 10pt) рекомендуется повышать разрешение до 400–600 DPI.

Отдельного внимания заслуживает фон. Фотографировать задание на пёстрой поверхности (скатерть, деревянный стол с текстурой) резко увеличивает вероятность ложного распознавания фоновых элементов как символов. Белый или однотонный нейтральный фон — не эстетическое предпочтение, а техническое требование: алгоритм бинаризации должен однозначно отделить тёмный символ от светлого фона.

Какие технические параметры фото критичны: освещение, угол, разрешение

Критичными для распознавания являются четыре параметра: разрешение (минимум 300 DPI или 1000×1000 пикселей), равномерность освещения без теней и бликов, угол съёмки (не более 10–15° от перпендикуляра к листу) и резкость фокусировки — при этом избыточное разрешение выше 600 DPI увеличивает время обработки, не улучшая точность.

Блики — особая проблема при съёмке страниц с глянцевым покрытием или ламинированных листов. Вспышка смартфона, направленная перпендикулярно листу, создаёт зеркальное отражение в центре кадра — именно там, где обычно находится основная часть текста. Решение: съёмка при естественном боковом освещении или с искусственным источником под углом 45°, при этом вспышка отключается принудительно.

Курсивный и жирный шрифт вносят дополнительную погрешность даже при идеальных условиях съёмки. OCR, обученный преимущественно на прямом шрифте, теряет 2–5 процентных пункта точности на курсиве из-за наклона букв, а жирное начертание приводит к «слипанию» соседних символов при бинаризации изображения.

Почему PNG лучше JPEG для фото заданий, которые обрабатывает OCR

JPEG использует алгоритм сжатия с потерями, который вносит артефакты блочности вокруг чётких контуров — именно вокруг символов. При коэффициенте сжатия JPEG ниже 85% (стандарт большинства мессенджеров при пересылке) эти артефакты визуально незаметны человеку, но принципиально меняют распределение пикселей на границах букв, что сбивает классификатор OCR. PNG сохраняет изображение без потерь. Если задание фотографируется непосредственно приложением-решателем — формат устанавливается автоматически. Проблема возникает, когда снимок передаётся через мессенджер и только затем загружается в сервис.

Где ломается точность: системные ограничения и типичные ошибки распознавания

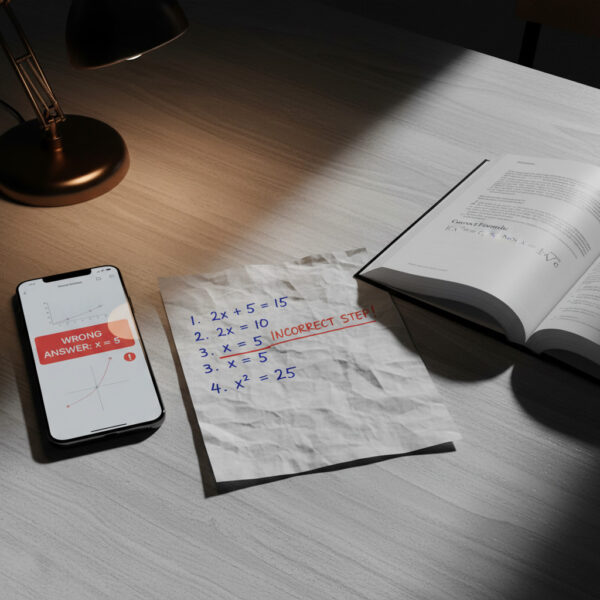

Точность фоторешателей ломается в четырёх системных точках: на границе между сегментами изображения, при конфликте визуально похожих символов, при нестандартной пространственной структуре выражения и при деградации качества снимка ниже порогового значения — и ни одна из этих точек не поддаётся полному устранению алгоритмическими методами.

Наиболее частая категория ошибок — конфликт визуально похожих символов. В математике критически опасны следующие пары: «0» и «O» (ноль и буква О), «1» и «l» (единица и строчная L), «2» и «Z», «5» и «S», запятая и точка в десятичных дробях. Для русскоязычных заданий добавляется конфликт кириллических и латинских символов: кириллическая «с» и латинская «c», «х» и «x» — при смешанном тексте и формулах система может переключаться между языковыми моделями, умножая ошибки.

Вторая системная точка разрыва — граница детекции текстовых блоков. Если на снимке два задания написаны рядом без чёткого визуального разделения, локализатор может объединить их в один блок или, напротив, разрезать одно уравнение на два независимых фрагмента. Результат — синтаксически бессмысленное выражение, которое вычислительное ядро либо отклонит с ошибкой, либо попытается решить, производя математически некорректный ответ.

Третья точка — деградация при каскадной передаче. Каждый раз, когда снимок сжимается (пересылка в мессенджере, сохранение в облаке с автосжатием), он теряет часть информации о контурах символов. Три пересылки через WhatsApp с настройками по умолчанию могут снизить эффективное разрешение фото с 300 до эквивалента 150 DPI — ниже порога надёжного распознавания.

По данным Conexiom (анализ OCR-ошибок в промышленных системах, 2024), размытие и низкое разрешение являются причиной №1 снижения точности OCR, опережая все другие факторы. Искажение и наклон текста занимают четвёртое место, но при работе с мобильными фото становятся значительно более частой проблемой, чем в документооборотных системах, где используются стационарные сканеры.

Четвёртая точка — ограничения обучающих данных. Любая модель точна ровно настолько, насколько репрезентативны данные, на которых она обучалась. Если модель обучена преимущественно на американских учебниках, она хуже распознаёт европейскую нотацию (запятая как десятичный разделитель вместо точки, другие обозначения дроби). Это не баг конкретного приложения — это фундаментальное свойство любой supervised-системы машинного обучения, которое устраняется только расширением и диверсификацией обучающей выборки.

Как развивались технологии фоторешения заданий: от Tesseract до мультимодальных LLM

Технологии фоторешения заданий прошли три принципиально разных поколения за 30 лет: от шаблонного OCR на основе сегментации — к нейросетевым пайплайнам с отдельными модулями — и наконец к мультимодальным языковым моделям, где распознавание и понимание задачи происходят в одной нейросети одновременно.

Первое поколение (1985–2017): Tesseract и шаблонные системы. Tesseract был разработан в Hewlett-Packard в 1985 году, в 2006-м передан Google в открытый доступ. В 1995 году он вошёл в тройку лучших систем по точности на независимом тесте UNLV — при том что работал на железе той эпохи. Ключевое ограничение: Tesseract версий 1–3 обрабатывал строки текста как последовательность изолированных символов, бинаризовал изображение (переводил в чёрно-белое) и сравнивал каждый символ с базой шаблонов. Для математических формул с их вертикальной структурой это было принципиально неприменимо.

Переломный момент — 2018 год. Google выпустил Tesseract 4.0 с LSTM-слоем: теперь система анализировала последовательности символов в контексте, а не каждый символ по отдельности. Точность на рукописном тексте выросла с ~65% до 78–82%. В тот же год хорватский стартап Photomath, основанный в 2014 году Дамиром Саболем на базе OCR-технологий компании Microblink, получил $6 млн Series A и закрепил модель «камера → пошаговое решение» как стандарт потребительских фоторешателей.

Photomath дебютировал на TechCrunch Disrupt в 2014 году — тогда же, когда был впервые представлен широкой аудитории. В 2016 году приложение добавило поддержку рукописного ввода, что резко расширило аудиторию. В 2023 году Photomath был приобретён Google — решение стратегически логичное: Google уже владел Tesseract и имел интерес к образовательным ИИ-инструментам.

Второе поколение (2019–2022): специализированные нейросетевые пайплайны. Появились архитектуры CRNN (сверточная + рекуррентная сеть), обученные непосредственно на математических датасетах. Модели Im2LaTeX и MathPix научились генерировать LaTeX-код напрямую из изображения формулы, минуя промежуточный текстовый этап. Инженерный компромисс этого поколения: высокая точность на конкретном типе задач (печатная алгебра, LaTeX-формулы), но узкая специализация — одна модель не умеет работать одновременно с текстом, формулами и чертежами.

Третье поколение (2023–н.в.): мультимодальные LLM. GPT-4V (2023) стал первой публично доступной моделью, способной одновременно «видеть» изображение и рассуждать о нём текстом. На бенчмарке MathVista (6141 задача из 28 датасетов, arxiv 2310.02255) GPT-4V достиг 49,9% точности — лучший результат среди 12 протестированных моделей, но на 10,4 процентных пункта ниже человеческой точности. К 2025 году Gemini 2.0 Flash вышел в лидеры на задачах с изображениями среди доступных мультимодальных моделей, хотя ни одна из них не достигла человеческого уровня на сложных визуально-математических задачах.

Парадокс третьего поколения: мультимодальные LLM хуже специализированных пайплайнов на задачах, где нужна точная символьная математика, но лучше на задачах с текстовым условием, смешанным контентом и нестандартными форматами. Исследование ICCV 2025 (VisionMath) показало, что при переходе от текстового к визуальному формату задачи точность GPT-4o mini на геометрических задачах падает с 58,1% до 53,4% — то есть само добавление изображения ухудшает результат, поскольку модель ещё не научилась стабильно интегрировать оба потока информации.

Почему специализированный решатель точнее LLM на алгебре — и когда это перестанет быть правдой

Специализированная система (OCR + CAS) работает детерминированно: одно и то же уравнение даёт один и тот же ответ при каждом запуске. LLM работает вероятностно: правильный ответ — это наиболее вероятный токен в обученном распределении, а не результат строгого вычисления. Это означает, что LLM может дать правильный ответ на задачу, которую «не умеет» решать формально, и неправильный — на тривиальную задачу, если обучающие данные содержали схожие, но неверно решённые примеры. По мере роста обучающих корпусов и появления верификаторов (моделей, проверяющих математическую корректность шагов решения) этот разрыв сокращается — но по состоянию на начало 2026 года он остаётся измеримым и практически значимым.

Эффективность фоторешателя определяется не брендом приложения, а качеством снимка и типом задания: печатная алгебра при разрешении от 300 DPI, перпендикулярном угле съёмки и рассеянном освещении распознаётся с точностью 95–99%, тогда как рукописные формулы или задачи с чертежами дают принципиально иной результат — 70–80% в лучшем случае. Три подхода закрывают разные сценарии: специализированные пайплайны (Photomath, MathPix) точны и детерминированы на стандартных алгебраических задачах, но не справляются с физикой и геометрией; мультимодальные LLM (GPT-4o, Gemini Vision) гибче работают со смешанным контентом и текстовыми условиями, однако теряют до 10 процентных пунктов точности по сравнению с человеком на визуально-математических бенчмарках (MathVista, 2023); готовые базы решений с поиском по фото — самый быстрый путь для стандартных школьных заданий из учебников, где задача уже решена и верифицирована. Выбор между этими тремя подходами — это инженерный компромисс между точностью, гибкостью и скоростью: ни одна система не закрывает все три параметра одновременно, и понимание этого факта позволяет использовать каждый инструмент там, где он даёт предсказуемый результат.

Для заданий из школьных учебников, где нужен быстрый поиск по фото, существуют специализированные ресурсы — например, ГДЗ по фото — которые работают с верифицированными решениями, а не с вероятностными предсказаниями модели.